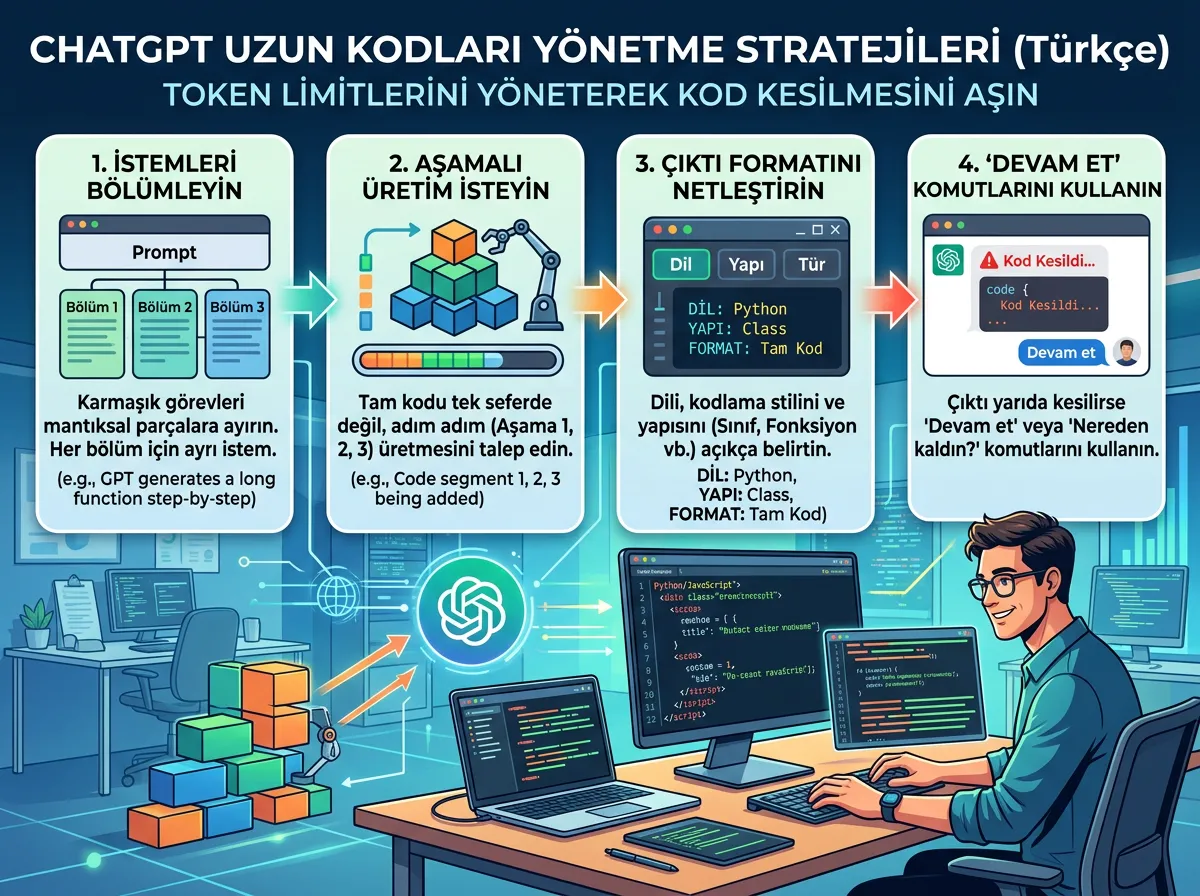

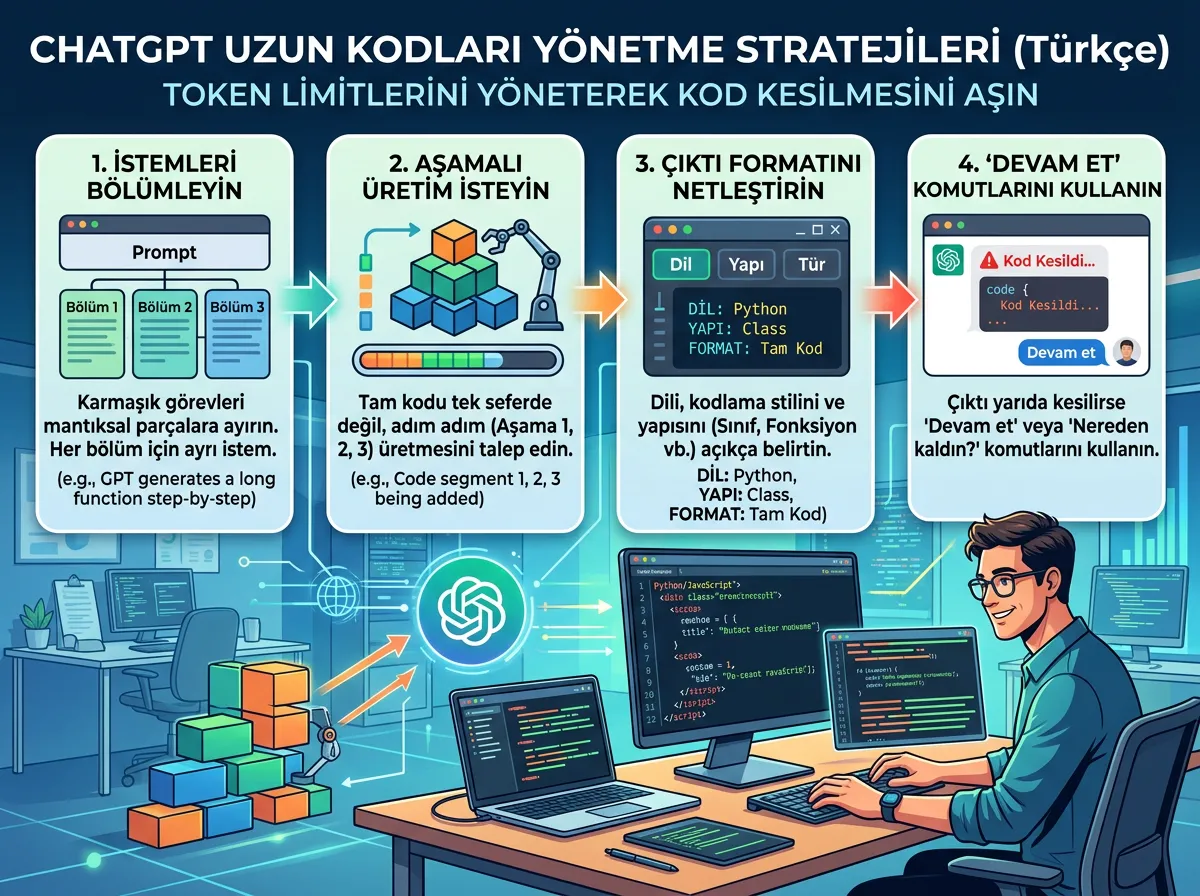

Kısa Cevap: chatgpt'de uzun kod bloklarının kesilmesini aşmak için istemleri bölümlere ayırma, aşamalı üretim talep etme, çıktı formatını netleştirme ve 'devam et' komutlarını kullanma gibi stratejiler uygulayarak token limitlerini yönetmelisin.

ChatGPT gibi büyük dil modelleriyle uzun kod blokları üretirken karşılaşılan kesinti sorunu, genellikle modelin belirlediği Token limitlerinden kaynaklanır. Bu limitler, hem girdi isteminin hem de üretilen çıktının toplam uzunluğunu kapsar. İş akışını kesintiye uğratan bu durumu aşmak için birkaç etkili prompt mühendisliği tekniği bulunmaktadır.

Öncelikle, kodun tamamını tek seferde istemek yerine, Bölümlere ayırarak talep etmek oldukça işe yarar. Örneğin, bir sınıfın metotlarını veya bir modülün farklı fonksiyonlarını ayrı ayrı istemek, modelin her bir parçayı eksiksiz üretmesine olanak tanır. Böylece her bir bölüm için ayrı bir token penceresi açılır.

İkinci olarak, Aşamalı üretim stratejisini benimseyebilirsin. Modelden kodu adım adım yazmasını isteyerek, her adımda belirli bir kısmı tamamlamasını sağlayabilirsin. Örneğin:

Gibi yönergelerle ilerleyebilirsin. Model bir adımı tamamladığında, 'Devam et' veya 'Kaldığın yerden devam et' gibi basit komutlarla bir sonraki bölüme geçmesini sağlayabilirsin.

Ayrıca, çıktı Formatını net bir şekilde belirtmek de önemlidir. Modelden sadece kodu vermesini, açıklama veya yorum eklememesini isteyebilirsin. Bu, gereksiz token tüketimini azaltır ve kod bloğunun daha uzun olmasını sağlar. Örneğin:

Gibi bir ifade kullanabilirsin.

Modelin belirli bir noktada kesilmesi durumunda, önceki çıktının son kısmını kopyalayıp yeni istemine ekleyerek 'Kaldığın yerden devam et' komutunu kullanmak, modelin bağlamı kaybetmeden kaldığı yerden devam etmesini sağlar. Bu, özellikle büyük dosya veya fonksiyonlar için kritik bir yaklaşımdır. Unutma ki, modelin token limitleri dinamik olabilir ve yoğun kullanıma bağlı olarak farklılık gösterebilir, bu yüzden esnek olmak ve bu teknikleri bir arada kullanmak en iyi sonuçları verecektir.