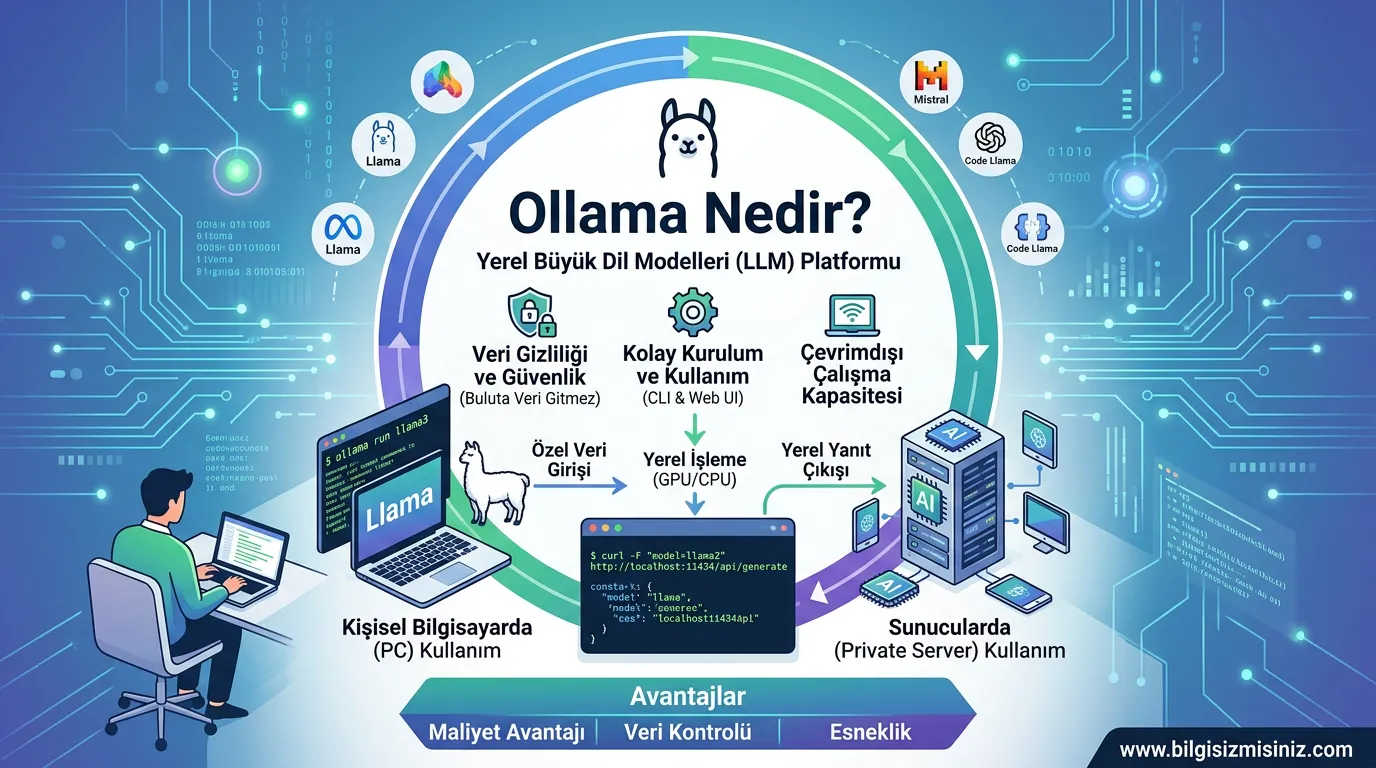

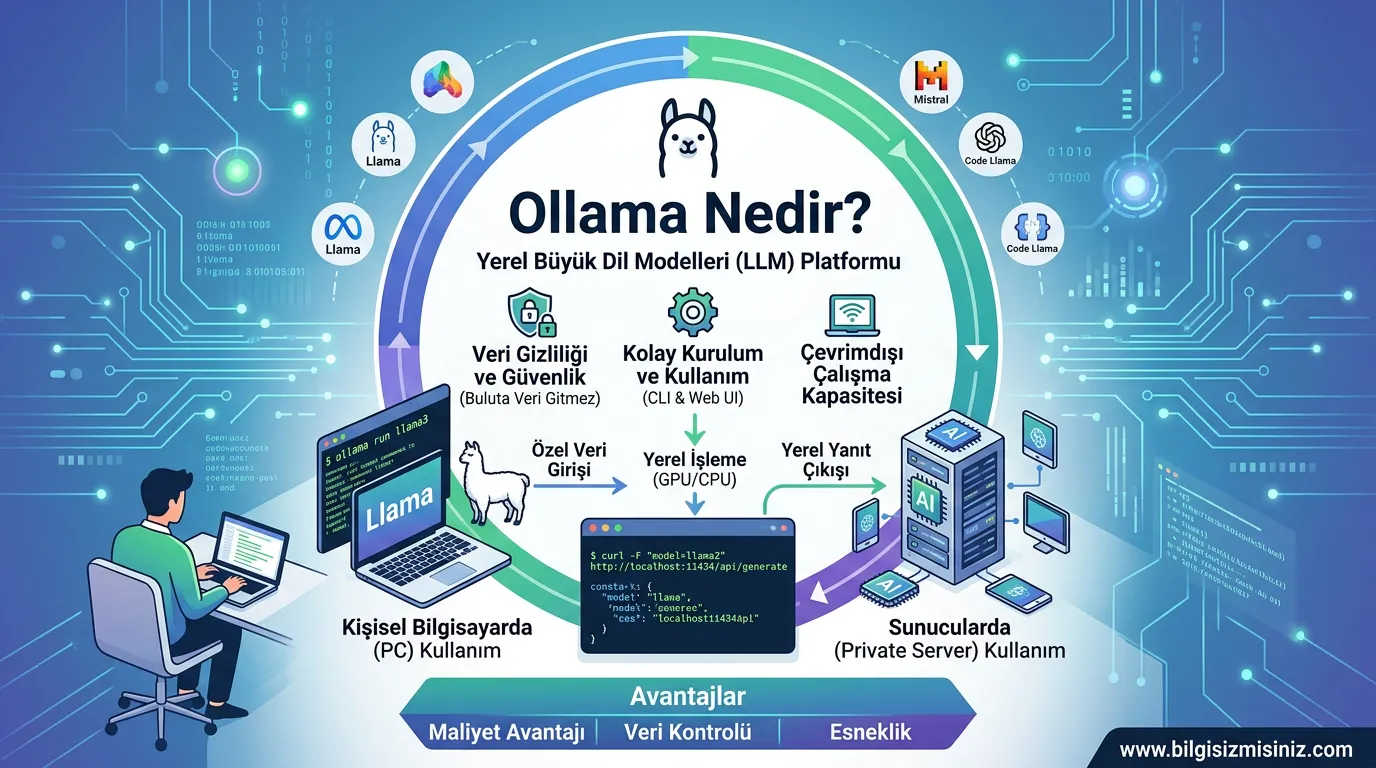

Kısa Cevap: Ollama, büyük dil modellerini (LLM) yerel bilgisayarınızda veya sunucunuzda kolayca ve verimli bir şekilde çalıştırmanızı sağlayan açık kaynaklı bir platformdur. Özellikle

gizlilik,

maliyet etkinliği ve düşük

gecikme süresi gerektiren uygulamalar için önemli avantajlar sunar.

Ollama, yapay zeka ve makine öğrenimi ekosisteminde, büyük dil modellerini yerel sistemlerde çalıştırma ihtiyacına yönelik geliştirilmiş güçlü bir araçtır. Temel olarak, çeşitli popüler açık kaynaklı LLM'leri (örneğin Llama 3, Mistral, Gemma) optimize edilmiş, genellikle GGUF formatında, kendi donanımınızda çalıştırmak için basit bir arayüz ve çalışma zamanı sunar.

Yerel olarak LLM çalıştırmanın en belirgin avantajları arasında veri gizliliği gelir. Hassas verilerinizi üçüncü taraf API'lere göndermek zorunda kalmazsınız, bu da özellikle kurumsal veya kişisel gizlilik odaklı projelerde kritik bir gerekliliktir. Ayrıca, bulut tabanlı API ücretlerinden kaçınarak maliyet etkinliği sağlar. İnternet bağlantısına bağımlılık olmadan, düşük gecikme süresiyle model yanıtları alabilirsiniz ki bu, gerçek zamanlı uygulamalar için hayati öneme sahiptir. Kendi donanımınızın kapasitesine bağlı olarak performansı optimize etme ve hatta modelleri kendi verilerinizle kişiselleştirme (fine-tuning) imkanı da mevcuttur.

Ollama'yı windows sisteminizde kullanmaya başlamak oldukça basittir:

- Kurulum: Ollama'nın resmi web sitesinden windows yükleyicisini indirip çalıştırın. Kurulum süreci genellikle birkaç tıklamayla tamamlanır ve Ollama arka planda bir servis olarak çalışmaya başlar.

- Model İndirme ve Çalıştırma: Komut istemcisini (CMD veya PowerShell) açın. İstediğiniz bir modeli indirmek ve hemen çalıştırmak için şu komutu kullanabilirsiniz:

- Bu komut, eğer sisteminizde 'llama3' modeli yoksa otomatik olarak indirir ve ardından interaktif bir sohbet oturumu başlatır. Diğer modeller için de benzer şekilde 'mistral', 'gemma' gibi model adlarını kullanabilirsiniz.

- Model Yönetimi: Mevcut modelleri listelemek için

- komutunu kullanabilirsiniz. Bir modeli sadece indirmek isterseniz

- komutu yeterlidir.

- API Erişimi: Ollama, modellerinize programatik olarak erişebilmeniz için yerel bir REST API sunar. Genellikle 'http://localhost:11434' adresinden erişilebilen bu API sayesinde, kendi uygulamalarınızı Python, JavaScript veya diğer dillerle geliştirerek Ollama modelleriyle entegre edebilirsiniz. Örneğin, bir JSON isteği ile metin üretimi yapabilir veya sohbet arayüzleri oluşturabilirsiniz.

- Özel Modeller: Kendi 'Modelfile' dosyanızı oluşturarak mevcut modelleri temel alıp kendi özel talimatlarınızı veya parametrelerinizi ekleyerek kişiselleştirilmiş modeller de oluşturabilirsiniz. Bu, belirli bir göreve veya veri setine daha uygun yanıtlar elde etmek için oldukça güçlü bir özelliktir.

Donanım gereksinimleri modelin büyüklüğüne göre değişir; daha büyük modeller genellikle daha fazla RAM ve tercihen bir NVIDIA veya AMD GPU gerektirir. Ancak Ollama, CPU üzerinde de oldukça iyi performans gösterebilir, bu da onu geniş bir kullanıcı kitlesi için erişilebilir kılar.